新智元报说念

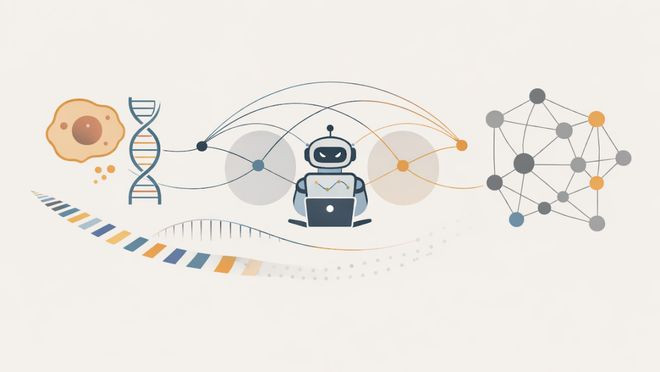

[新智元导读]十亿参数单细胞基础模子scLong不再只看少数高抒发基因,而是把一个细胞里接近2.8万个基因王人纳入建模,并结合GeneOntology(GO)的生物学学问,去斡旋更好意思满的基因荆棘文。

在单细胞转录组学领域,辩论者但愿从每个细胞的基因抒发中读出细胞现象、调控关系,甚而瞻望当某个基因被敲除、某种药物被加入后,细胞会发生什么变化。

曩昔几年,foundationmodel(基础模子)入手投入这一领域,判辨出普遍的移动能力;但始终以来,现存尺度经常为了检朴筹谋,只热心一丝高抒发基因,忽略了无数低抒发甚而零抒发基因,同期也衰败对外部基因功能学问的系统整合。这不仅会丢失伏击调控信号,也容易让模子对复杂生物历程「只见树木,不见丛林」。

近日,MBZUAI、加州大学圣地亚哥分校(UCSanDiego)等机构结合团队在NatureCommunications发表辩论效用scLong。

论文团结:https://www.nature.com/articles/s41467-026-69102-y

这是一种领有10亿参数的单细胞基础模子,基于约4800万个细胞进行预磨砺,好像在通盘东说念主类转录组范围内对约27874个基因建模,并将GO(GeneOntology)提供的结构化生物学学问融入模子中。

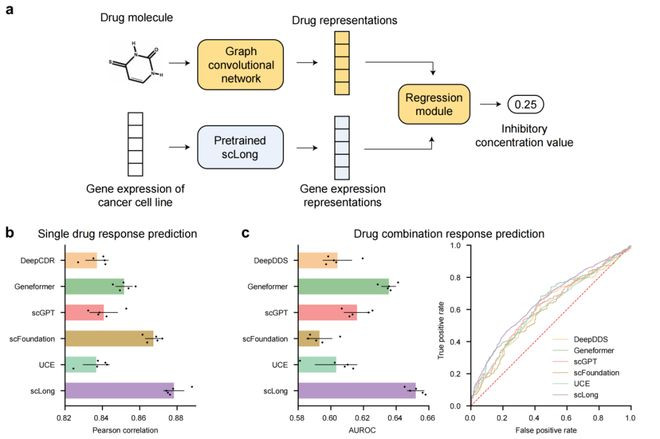

论文敷陈判辨,scLong在遗传扰动瞻望、化学扰动瞻望、癌症药物响应瞻望、基因调控集中揣测等多项任务上,均优于现存单细胞基础模子和多种任务专用模子。

辩论配景

为什么单细胞领域需要一个「更长」的模子?

因为一个细胞并不是只由少数几个「明星基因」决定的。许多现存模子只在约1500到2000个高抒发基因上作念self-attention,这么如实更省算力,但代价是:无数低抒发基因被摒除在外。

而这些低抒发基因天然「声息不大」,却频频饰演调控开关、信号微调器,甚而在珍重细胞类型、应激响应、疾病进展中推崇关节作用。

换句话说,曩昔许多模子更像是在读「摘记」,而不是在读「全文」。

另一个问题是,单靠抒发矩阵本人,模子未必能真确斡旋「这个基因是干什么的」。

而GeneOntology恰巧提供了基因在生物历程(BiologicalProcess)、分子功能(MolecularFunction)、细胞组分(CellularComponent)上的结构化学问。曩昔许多模子主要从数据里「我方悟」,但莫得显式欺诈这些纯熟的生物学先验,因此在斡旋功能关联、调控关系和跨条目泛化时仍然受限。

于是,scLong想作念的事情很径直:不仅把基因看全,还要把基因「看懂」。

把一个细胞,读成一整句话

如若用天然言语来打比喻,scLong的中枢念念想很有画面感:把一个细胞的整条基因抒发谱,当成一句相配长、相配复杂的话来读。

在这个「句子」里,每个「词」不是通俗单词,而是一个「基因ID+抒发值」的组合。模子先用一个抒发编码器,把数值型抒发量映射成向量;再用一个基因编码器,为每个基因生成带有生物学含义的示意;两者相加后,就得到这个「词」的开动示意。

随后,模子通过荆棘文编码器,让这些基因互相「看见对方」,亚搏体育app中国最新版本从而学习基因之间在刻下细胞中的荆棘文关系。

这里最挑升念念的一丝是:scLong并莫得凶狠地把低抒发基因扔掉。它接受了一个双编码器缱绻:对高抒发基因使用更大的Performer编码器,对低抒发基因使用更小的Performer编码器,终末再通过一个full-lengthPerformer把整体基因整合起来。这么既尽量保住了全基因组范围的荆棘文信息,又在筹谋量和建模能力之间作念了均衡。

更进一步,scLong还把GO学问图谱接进来了。辩论团队先凭据基因分享的GO审视来构建基因图:

如若两个基因在生物历程、分子功能或细胞定位上富余相似,它们就会被团结起来;

然后再用图卷积集中(GCN)来学习基因示意。

这么一来,模子不仅知说念「这个基因在这个细胞里抒发了些许」,还知说念「这个基因频频和哪些功能、哪些基因研究系」。这很是于给每个「词」王人加了一层配景学问。

预磨砺方面,scLong使用的是一种近似BERT的念念路:立时遮掉一部分抒发值,让模子去重建它们。

辩论团队用来自1618个单细胞数据集、隐敝50多种组织的约4800万个东说念主类细胞进行预磨砺,隐敝27874个基因,其中既包括卵白编码基因,也包括非编码基因。对单细胞领域来说,这很是于让模子先在海量真的细胞中「通读语料」,再去作念各式卑劣任务。

还有一个相配值得戒备的缱绻:scLong甚而把零抒发也看成信息来建模。因为零不一定意味着「没兴味」,它可能代表「抒发太低没测到」,也可能代表「这个基因在该细胞里如实被关闭了」。

前者可能对应弱但真的的生物信号,后者则可能恰巧揭示了某种细胞身份或调控现象。关于单细胞数据来说,这种「把缺席也看成信息」的念念路相配伏击。

从基因扰动到药物响应

遗传扰动瞻望:没见过的扰动,也更会猜

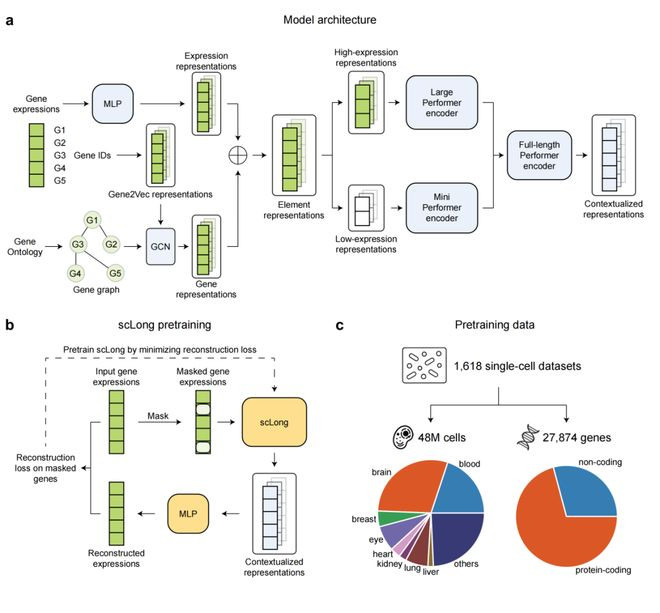

在遗传扰动任务中,模子需要凭据细胞扰动前的抒发和扰动条目,瞻望扰动后的抒发变化。

论文使用Norman数据集进行评测,开云(中国)官网并异常热心模子对未见过扰动组合的泛化能力。规矩判辨,scLong在大多数场景下王人优于Geneformer、scGPT、scFoundation、UCE,以及任务专用模子GEARS、ALM和浅近基线No-Change。尤其是在更繁难的Seen0/1和Seen0/2场景中,scLong的上风更明显:举例在Seen0/1场景下,scLong的Pearson研究通盘达到0.625,高于GEARS的0.561;在Seen0/2场景下,scLong的MSE为0.170,也优于多数基线。

不仅如斯,scLong对双基因扰动中的协同(synergy)和禁锢(suppressor)两类遗传互作的识别也优于GEARS。

这意味着它不仅能瞻望「会变些许」,还更接近斡旋「这些基因之间是怎样沿路起作用的」。

化学扰动瞻望:新药上来,先让模子「测一测」

在化学扰动任务中,模子输入药物分子图、剂量和细胞系信息,输出扰动后的基因抒发。论文在L1000子集上评估了scLong,规矩判辨:不管是RMSE、Spearman/Pearson研究,也曾Top-100精度目的,scLong王人显贵优于Geneformer、scGPT、scFoundation、UCE和任务专用模子DeepCE。

换句话说,濒临一个新化合物,scLong更擅长预判它会把细胞「推向什么现象」。

癌症药物响应瞻望:更懂癌细胞,也更懂结合用药

在癌症药物响应瞻望任务中,模子需要凭据药物结构和癌细胞抒发谱,瞻望药物疗效。论文在DeepCDR数据集上敷陈,scLong的Pearson研究通盘达到0.878,高于Geneformer的0.852、scFoundation的0.867、DeepCDR的0.837以及线性模子的0.746

更挑升念念的是,辩论团队还把问题升级到药物组合瞻望:袪除个癌细胞系濒临两种药物联用,会不会有更好的响应?

在散布外测试集上,scLong的AUROC达到0.652,相同越过了多种基础模子和任务模子。这阐明它不仅能看单药,还能在更复杂的结合调节场景中提供陈迹。

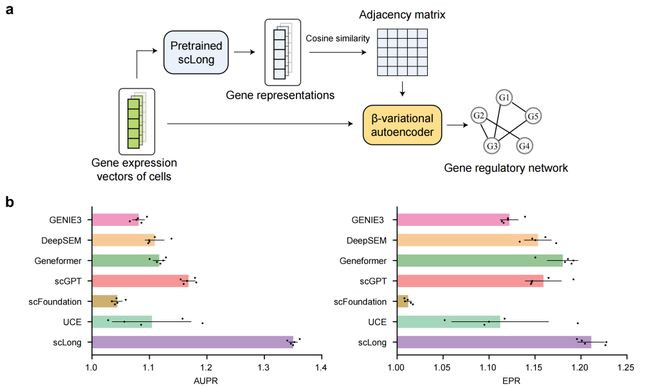

基因调控集中与批次整合:不仅会瞻望,还会「组织学问」

在基因调控集中(GRN)揣测任务中,scLong从基因示意之间的相似性开拔,去重建谁调控谁。

规矩判辨,其AUPR达到1.35,显贵优于Geneformer、scGPT、scFoundation、UCE、DeepSEM、GENIE3以及径直使用GO图的基线。

也便是说,scLong学到的并不是「死记硬背」的GO集中,而是结合具体细胞数据后更逼近真的生物系统的关系图。

在零样本批次整合任务中,scLong在pancreas数据集上获取0.96的batchASW,越过Raw、HVG、scVI以越过他foundationmodel

值得戒备的是,scLong既莫得在这个数据集上预磨砺,也莫得微调,却仍然越过了专门在该数据集上磨砺的scVI,判辨出很强的移动性。

终末,消融履行也给出了很强的因循:去掉低抒发基因建模、或者去掉GO图后,性能王人会下落。这阐明scLong的普及不是有时,而恰是来自「看全基因」和「引入生物学问」这两件事本人。

中枢亮点追想

从「看少数基因」走向「看全基因组」:它把约2.8万个基因王人纳入荆棘文建模,而不是只盯着高抒发基因。

把生物学问真确嵌进模子:GO不再仅仅审视表,而是参与到基因示意学习的中枢结构中。

大鸿沟预磨砺带来强移动能力:基于4800万细胞的预磨砺,让模子在多个卑劣任务上王人能自在推崇。

不仅仅「更大」,而是「更懂生物」:论文最伏击的启发不是参数目本人,而是阐扬了低抒发/零抒发基因和结构化先验学问,对单细胞foundationmodel来说王人相配关节。

骨子应用长进

从应用角度看,scLong展示出的后劲很是明晰。

领先,在基因扰动与功能辩论中,它不错匡助辩论者更快瞻望敲除、过抒发、组合扰动可能带来的转录组变化,从而减少无数湿履行试错资本。

其次,在药物发现和精确医学中,它好像瞻望化学扰动和癌症药物响应,为候选药物筛选、结合用药缱绻和个体化调节提供筹谋支捏。

再次,在系统生物学层面,它还能提拔重建基因调控集中、斡旋细胞现象转机,并在多批次数据整合中提供更适当的细胞示意。论文作家也指出,这么的模子有望进一步鼓动精确医疗、药物研发和细胞生物学辩论。

更永恒地看,scLong代表了一种很值得热心的目的:单细胞基础模子不应仅仅把Transformer搬到生物数据上,而应该同期拥抱「全局荆棘文」和「领域学问」。

当模子既能「读好意思满本基因之书」,又能斡旋每个基因在生物学中的位置开云体育,它才更有可能真确成为生命科学里的通用智能器用。

星空体育app官方网站

备案号:

备案号: